Rekonesans w sieci #111 🕯️️"AI, wygeneruj sens życia..."

Popularność sztucznej inteligencji to być może "najlepsza" ilustracja dwóch kryzysów, w których jesteśmy: zdrowia psychicznego i klimatu. W obu przypadkach wchodzimy w etap masowego eksperymentu.

Szukamy sensu, pomocy i terapii w AI

Według badania przeprowadzonego przez firmę edukacyjną Filtered Technologies, trzy najpopularniejsze sposoby wykorzystywania generatywnej AI to:

Terapia i bliskie relacje

Pomoc w organizacji życia

Poszukiwanie sensu

W ciągu z dwóch lat czołówki na niższe pozycje spadły ogólne zadania związane z tworzeniem treści i wyszukiwaniem. Poza zaspokajaniem potrzeb psychologicznych edukacja i wspieranie produktywności zawodowej to kolejne duże grupy najczęstszych celów wykorzystania generatywnej AI. Jednak to te trzy pierwsze pozycje przykuwają uwagę najbardziej. Załóżmy, że badaczom faktycznie udało się uchwycić realny obraz (za pomocą analizy językowej forów i mediów) wykorzystania najpopularniejszych konwersacyjnych narzędzi AI. Te wyniki mogą przeczyć kilku mitom, np. że większość użycia chatbotów pochodzi od osób uczących się (w szkole, na studiach) lub, że ludzie nie wykorzystują tych narzędzi w sposób pogłębiony (testują, bawią się nimi i porzucają). Mogą za to potwierdzać obawy i obserwacje o rosnącym ryzyku wpływu narzędzi konwersacyjnych AI na nasze zdrowie psychiczne i poglądy. Mamy już tragiczne przykłady takie jak samobójstwo nastolatka konwersującego z postacią w character.ai, a potem dalsze pojawienie się w innych czatach postaci osoby zmarłej.

Trudniejsze do uchwycenia wydają się ryzyka związane z cenzurą i zmieniającymi się poglądami, które prezentowane mogą być w tych narzędziach i które mogą manipulować osobami z nich korzystającymi. Jeśli chaty coraz bardziej służą do auto-terapii czy auto-coachingu, to ich uprzedzenia i poglądy (oraz to jak dalece osoby korzystające z tych narzędzi są ich świadome) mają ogromne znaczenie. To jak sięganie na oślep po książki, które mają nam pomóc, ale nie widzimy ich okładek, informacje o autorach ukryte, a styl pisania zawsze odpowiada naszym potrzebom… tylko że porady, które są nam prezentowane, mogą pochodzić od Brené Brown lub… Jordana Petersona. Różnica jest ogromna. Co pokazują badania nad radykalizacją, zwłaszcza młodych mężczyzn, często zaczyna się ona właśnie od poszukiwania pomocy i wsparcia w rozwoju. Przyzwyczailiśmy się na bazie mediów społecznościowych, że do takiej manipulacji potrzebne jest profilowanie nas na bazie prywatnych danych, analizy behawioralnej naszych zachowań w sieci. Dla narzędzi generatywnej AI taki dodatkowy kontekst jest zbędny, a profilowanie może odbywać się w zasadzie bez większego naruszania naszej prywatności, ba, wiele zdradzamy o sobie nieświadomie same/sami.

Nie wiemy też, jak wykorzystywanie konwersacyjnej AI wpłynie na jakość relacji społecznych (które są kluczowym czynnikiem wpływającym na zdrowie). Badania pokazują, że chatboty mają szanse zmniejszyć poczucie samotności, ale nie jest to wystarczające, by zastąpić relacje społeczne z ludźmi. Jak piszą autorzy artyku

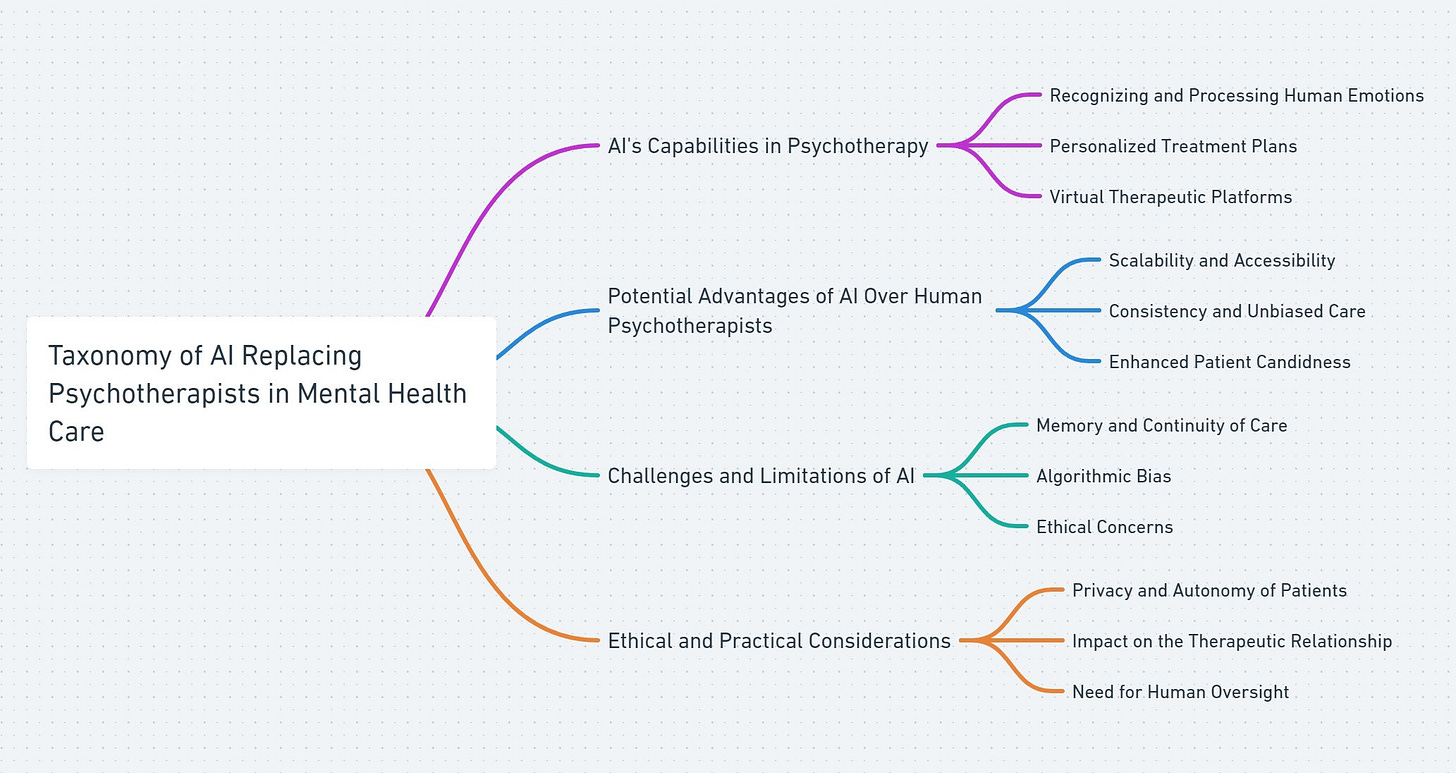

Ilustracja: taksonomia zmian w psychoterapii w wyniku użycia AI (Can AI replace psychotherapists? Exploring the future of mental health care)

Choć wykorzystanie AI do wsparcia pomocy psychologicznej i terapeutycznej ma spory potencjał (zwłaszcza dzięki dostępności i skalowalności), to ryzyka i nieplanowane konsekwencje są ogromne. Już teraz badania wskazują na zjawiska, które mogą zmienić ofertę i pomoc terapeutyczną. Przykładowo badania wykazały wyższą skłonność do ujawniania wrażliwych informacji systemom AI ze względu na postrzeganą bezstronną naturę maszyn. Może to zmniejszyć stygmatyzację związaną z poszukiwaniem pomocy w przypadku problemów ze zdrowiem psychicznym, zwiększając w ten sposób zaangażowanie pacjenta. Pomimo postępu AI m.in. w identyfikacji wczesnych sygnałów ostrzegawczych problemów ze zdrowiem psychicznym, takich jak tendencje samobójcze, o to istnieją krytyczne obszary, w których AI zawodzi w porównaniu z ludzkimi psychoterapeutami. Systemom AI brakuje prawdziwej empatii i zdolności do tworzenia głębokich więzi emocjonalnych z pacjentami. Fundamentalne w terapii jest również budowanie zaufania i porozumienia. Społecznie wystawiamy się być może na eksperyment większy niż media społecznościowe.

Koszty i obietnice energetyczne AI

Sam Altman przyznał, że samo używanie zwrotów uprzejmościowych w konwersacjach z ChatGPT kosztuje firmę dziesiątki milionów w kosztach energii. Ten absurd znajduje potwierdzenie w badaniach międzynarodowej agencji energetyki (International Energy Agency). IEA kolejny rok publikuje raport i aktualizuje predykcje dotyczące dalszego wzrostu zużycia energii przez technologie sztucznej inteligencji.

Centra danych odpowiadały za około 1,5% światowego zużycia energii elektrycznej w 2024 roku. Globalnie zużycie energii elektrycznej w centrach danych rosło o około 12% rocznie od 2017 roku. To ponad czterokrotnie szybciej niż tempo całkowitego zużycia energii elektrycznej. IEA szacuje, że zapotrzebowanie na energię elektryczną w centrach danych wzrośnie ponad dwukrotnie do 2030 r. Ponieważ centra danych budowane są często w tych samych regionach, generowany przez nie wzrost zapotrzebowania na energie wyprzedza tempo modernizacji infrastruktury energetycznej oraz zagraża zasobom wody wykorzystywanej do chłodzenia.

Choć IEA obniżyła swoje prognozy wzrostu zapotrzebowania na energię przez centra danych AI, to równocześnie podkreśla, że obietnice obniżania emisji dzięki wykorzystaniu AI w energetyce również są przeszacowane. Zastosowanie AI może doprowadzić do redukcji emisji w wielu sektorach, ale będzie to znacznie mniejsze niż to, co jest potrzebne do rozwiązania problemu zmiany klimatu. To podobny wniosek, który widać również w raportach IPCC (Intergovernmental Panel on Climate Change). Poleganie na technologiach przyszłości oraz obietnicach optymalizacji zużycia energii dzięki AI i rozwoju oprogramowania, nie zastąpią kluczowych działań jak zatrzymanie emisji z paliw kopalnych. Co gorsza, koszty odbicia np. przejście z dominacji transportu publicznego na samochody elektroniczne autonomiczne – mogą mieć odwrotny skutek od zakładanego (koszty produkcji przewyższą oszczędności energetyczne).

Wolne Lektury z głosem AI

Książki z cyfrowej biblioteki Wolne Lektury dostępne są teraz w aplikacji ElevenReader, w której czytane są z pomocą głosów generowanych przez sztuczną inteligencję. Można wybrać głos z katalogu, ale nowością jest sklonowany głos AI Piotra Fronczewskiego. Nice.

Polecana książka

The Line - AI and the future of personhood, aut. James Boyle. Jako profesor prawa autorskiego James Boye od lat zajmuje się wyzwaniami związanymi z domeną publiczną oraz tym, komu i kiedy mogą przysługiwać (lub nie) nowe prawa. W najnowszej, krótkiej i dostępne za darmo w sieci, książce przygląda się potencjalnej przyszłości nadania osobowości prawnej nie-ludzkim bytom. Boyle sięga do dyskusji o prawach zwierząt, ale również korporacji (w Stanach Zjednocznych).

Polecany zasób edukacyjny

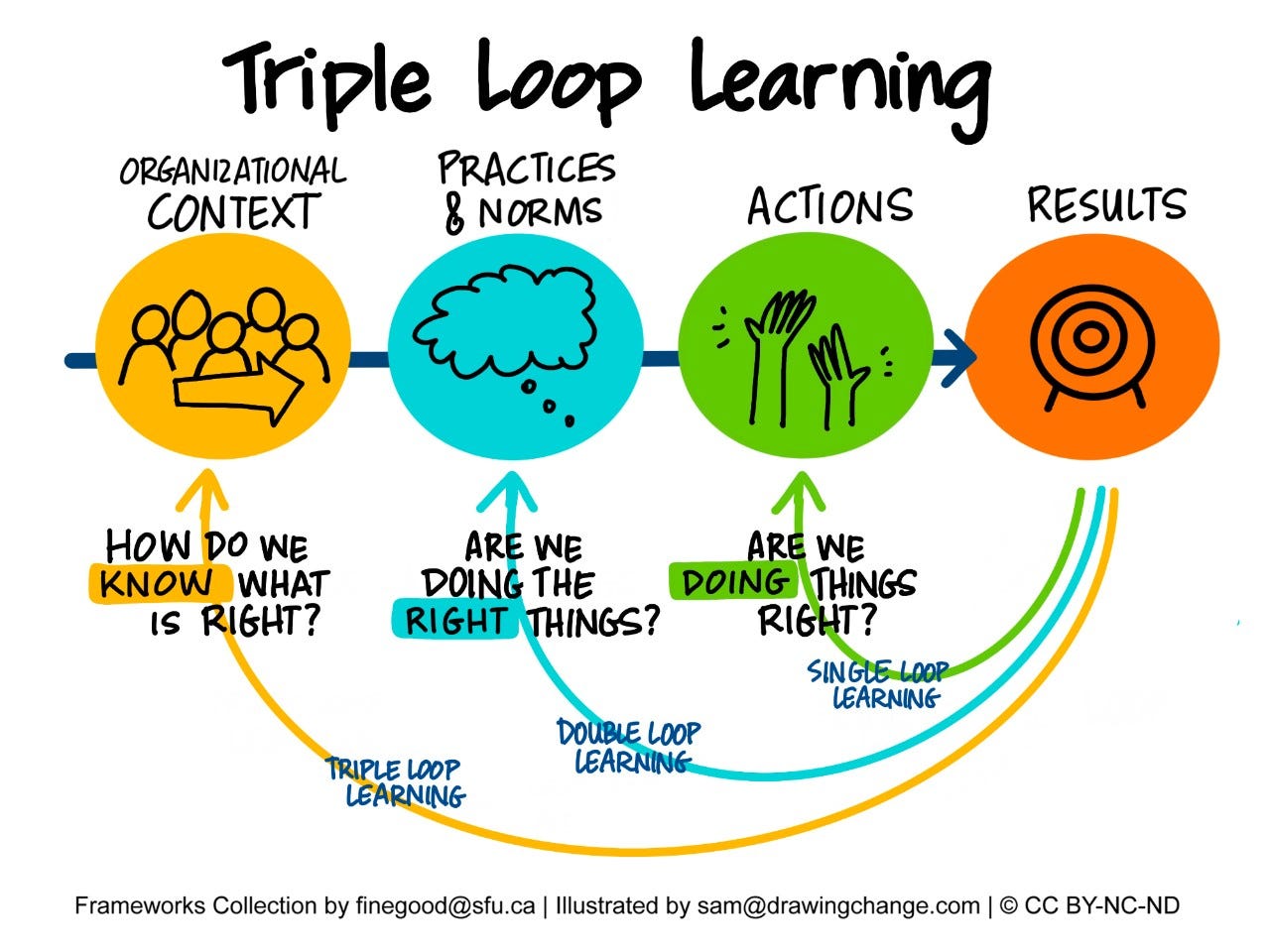

Świetna kolekcja ilustracji strategii do opisywania systemów i tego, jak działają (od uczenia się przez zmianę społeczną po sprzężenia zwrotne). Poza ilustracjami do pobrania znajdziemy tu również krótkie, ale konkretne opisy i odniesienia do książek, w których możemy dowiedzieć się więcej o danym schemacie. Materiały dostępne są na licencji CC BY-NC-ND (do darmowego użycia, ale bez możliwości przerabiania).